Más de lo que crees, los bots de IA (inteligencia artificial) y ML (aprendizaje automático) rastrean tu sitio y extraen tu contenido. Recopilan y utilizan tus datos para entrenar software como ChatGPT, OpenAI, DeepSeek y miles de otras creaciones de IA .

Si quieres evitar que los bots de IA rastreen tus páginas web, aquí tienes la lista más completa posible sobre bots de IA a bloquear, para que no se queden con tu contenido, sin retribución alguna a tu sitio.

Cómo bloquear todos los bots de inteligencia artificial con el archivo robots.txt

La forma más sencilla para la mayoría de los propietarios de sitios web de bloquear los bots de IA es hacerlo desde el archivo robots.txt.

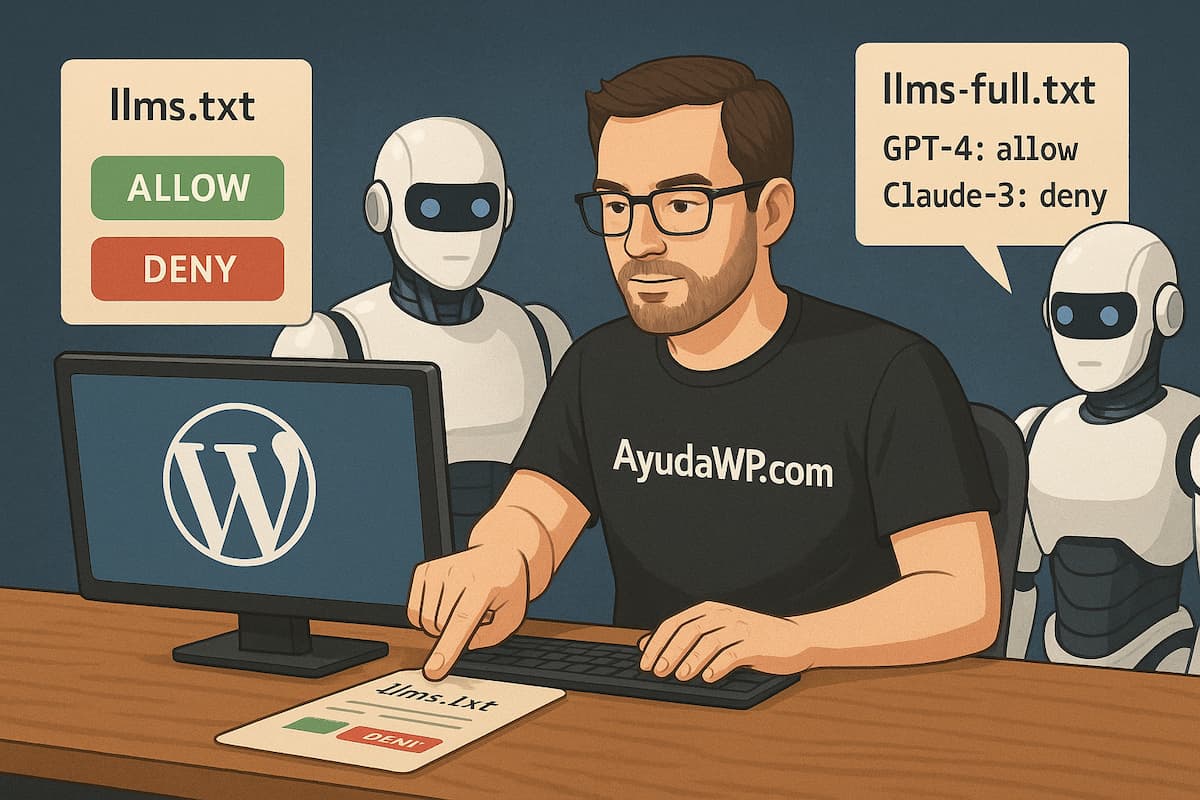

El archivo robots.txt es un archivo que contiene reglas que deben obedecer los robots de rastreadores y similares. Por lo tanto, puedes añadir reglas que limiten dónde pueden rastrear los robots, ya sea páginas individuales o el sitio completo.

Cuando hayas añadido las reglas de rastreo que quieras incorporar, simplemente sube el archivo robots en el directorio raíz público de tu web. Por ejemplo, aquí está mi archivo robots.txt para Ayuda WordPress.

Para bloquear los bots de IA a través del archivo robots.txt de su sitio añade las siguientes reglas. Ten en cuenta que los bots no están obligados a obedecer las reglas de robots.txt. Las reglas de robots son meras sugerencias. Los bots buenos seguirán las reglas, los bots malos las ignorarán y harán lo que quieran.

Para forzar el cumplimiento, puede añadir reglas de bloqueo a través de Apache/.htaccess (más abajo). Teniendo esto en cuenta, aquí están las reglas de robots para bloquear los bots de IA:

#Bloquear bots de todas las IAs #https://perishablepress.com/ultimate-ai-block-list/ User-agent: Agent GPT User-agent: AgentGPT User-agent: AIBot User-agent: AI2Bot User-agent: AISearchBot User-agent: AlexaTM User-agent: Alpha AI User-agent: AlphaAI User-agent: Amazon Bedrock User-agent: Amazon Lex User-agent: Amazonbot User-agent: Amelia User-agent: anthropic-ai User-agent: AnyPicker User-agent: Applebot User-agent: AutoGPT User-agent: AwarioRssBot User-agent: AwarioSmartBot User-agent: Brave Leo AI User-agent: Bytespider User-agent: CatBoost User-agent: CC-Crawler User-agent: CCBot User-agent: ChatGPT User-agent: Chinchilla User-agent: Claude-Web User-agent: ClaudeBot User-agent: cohere-ai User-agent: cohere-training-data-crawler User-agent: Common Crawl User-agent: commoncrawl User-agent: Crawlspace User-agent: crew AI User-agent: crewAI User-agent: DALL-E User-agent: DataForSeoBot User-agent: DeepMind User-agent: DeepSeek User-agent: DepolarizingGPT User-agent: DialoGPT User-agent: Diffbot User-agent: DuckAssistBot User-agent: FacebookBot User-agent: Firecrawl User-agent: Flyriver User-agent: FriendlyCrawler User-agent: Gemini User-agent: Gemma User-agent: GenAI User-agent: Google Bard AI User-agent: Google-CloudVertexBot User-agent: Google-Extended User-agent: GoogleOther User-agent: GPT-2 User-agent: GPT-3 User-agent: GPT-4 User-agent: GPTBot User-agent: GPTZero User-agent: Grok User-agent: Hugging Face User-agent: iaskspider User-agent: ICC-Crawler User-agent: ImagesiftBot User-agent: img2dataset User-agent: IntelliSeek.ai User-agent: ISSCyberRiskCrawler User-agent: Kangaroo User-agent: LeftWingGPT User-agent: LLaMA User-agent: magpie-crawler User-agent: Meltwater User-agent: Meta AI User-agent: Meta Llama User-agent: Meta.AI User-agent: Meta-AI User-agent: Meta-ExternalAgent User-agent: Meta-ExternalFetcher User-agent: MetaAI User-agent: Mistral User-agent: OAI-SearchBot User-agent: OAI SearchBot User-agent: omgili User-agent: Open AI User-agent: OpenAI User-agent: PanguBot User-agent: peer39_crawler User-agent: PerplexityBot User-agent: PetalBot User-agent: RightWingGPT User-agent: Scrapy User-agent: SearchGPT User-agent: SemrushBot User-agent: Sidetrade User-agent: Stability User-agent: The Knowledge AI User-agent: Timpibot User-agent: VelenPublicWebCrawler User-agent: WebChatGPT User-agent: Webzio User-agent: Whisper User-agent: x.AI User-agent: xAI User-agent: YouBot User-agent: Zero GTP Disallow: /

Bloquear bots de IA a través de Apache/.htaccess

Para aplicar la lista de bloqueo de IA definitiva puedes añadir las siguientes reglas a tu configuración de Apache o al archivo .htaccess principal, lo que sería la manera más fiable para bloquear bots de las IAs.

Para bloquear los bots de IA a través de Apache/.htaccess, añade estas reglas al archivo de configuración de su servidor o al archivo .htaccess principal (raíz pública) y guarda los cambios.

#BEGIN Bloquear bots de IA

<IfModule mod_rewrite.c>

RewriteEngine On

RewriteCond %{HTTP_USER_AGENT} (Agent\ GPT|AgentGPT|AIBot|AI2Bot|AISearchBot|AlexaTM|Alpha\ AI|AlphaAI|Amazon\ Bedrock|Amazon\ Lex|Amazonbot) [NC,OR]

RewriteCond %{HTTP_USER_AGENT} (Amelia|anthropic-ai|AnyPicker|Applebot|AutoGPT|AwarioRssBot|AwarioSmartBot|Brave\ Leo\ AI|Bytespider|CatBoost) [NC,OR]

RewriteCond %{HTTP_USER_AGENT} (CC-Crawler|CCBot|ChatGPT|Chinchilla|Claude-Web|ClaudeBot|cohere-ai|cohere-training-data-crawler|Common\ Crawl) [NC,OR]

RewriteCond %{HTTP_USER_AGENT} (commoncrawl|Crawlspace|crew\ AI|crewAI|DALL-E|DataForSeoBot|DeepMind|DeepSeek|DepolarizingGPT|DialoGPT|Diffbot) [NC,OR]

RewriteCond %{HTTP_USER_AGENT} (DuckAssistBot|FacebookBot|Firecrawl|Flyriver|FriendlyCrawler|Gemini|Gemma|GenAI|Google\ Bard\ AI|Google-CloudVertexBot) [NC,OR]

RewriteCond %{HTTP_USER_AGENT} (Google-Extended|GoogleOther|GPT-2|GPT-3|GPT-4|GPTBot|GPTZero|Grok|Hugging\ Face|iaskspider|ICC-Crawler|ImagesiftBot) [NC,OR]

RewriteCond %{HTTP_USER_AGENT} (img2dataset|IntelliSeek\.ai|ISSCyberRiskCrawler|Kangaroo|LeftWingGPT|LLaMA|magpie-crawler|Meltwater|Meta\ AI|Meta\ Llama) [NC,OR]

RewriteCond %{HTTP_USER_AGENT} (Meta\.AI|Meta-AI|Meta-ExternalAgent|Meta-ExternalFetcher|MetaAI|Mistral|OAI-SearchBot|OAI\ SearchBot|omgili|Open\ AI) [NC,OR]

RewriteCond %{HTTP_USER_AGENT} (OpenAI|PanguBot|peer39_crawler|PerplexityBot|PetalBot|RightWingGPT|Scrapy|SearchGPT|SemrushBot|Sidetrade|Stability) [NC,OR]

RewriteCond %{HTTP_USER_AGENT} (The\ Knowledge\ AI|Timpibot|VelenPublicWebCrawler|WebChatGPT|Webzio|Whisper|x\.AI|xAI|YouBot|Zero\ GTP) [NC]

RewriteRule (.*) - [F,L]

</IfModule>

#END Bloquear bots de IA

Este método bloquea los mismos bots de IA que la anterior mediante robots.txt, la diferencia está en el que el método de robots.txt depende de que los bots hagan caso a la regla de disallow o no, mientas que mediante el método de .htaccess se bloquea realmente a los bots de las IAs listados.

¿Te gustó este artículo? ¡Ni te imaginas lo que te estás perdiendo en YouTube!

Hola. Muy muy útil como siempre.

Pero para mí la pregunta es: ¿a dónde va el mercado de búsqueda? No voy al tema técnico sino a qué le interesa hacer a cada sitio web. Te soy concreto. Ayudo a un amigo con un blog de baloncesto que consigue un gran tráfico natural, con muchísimo contenido original. Tanto que la gente lo usa para hacer trabajos sin citarlo, tenemos algún plugin que impide cortar y pegar para que por lo menos la gente no lo fusile tanto.

Pero el sitio vive de lo que funciona en páginas profundas en búsquedas. Y lo que no sé recomendarle a mi amigo es si debemos bloquear las arañas de IA para que no le sirvan a la gente su contenido directamente o si quedarnos fuera de esas arañas es dejar su web que funciona tan bien fuera de las nuevas búsquedas… Esa es la pregunta para mí…

No sé si habrá probado con un muro de pago, que en webs muy útiles a veces tiene encaje.

Sobre si indexar para IAs o no, lo que ya hayan «absorvido» es inevitable, no sé si ya llegamos tarde. En mi caso comprobé que lo que había «importado» del blog era como un 70%, una barbaridad, y he preferido bloquear los bots principales, más por principios que por efectividad real.

No, nunca lo hemos hecho. Nos quedamos en pensar que deberíamos por lo menos exigir estar registrado para acceder a todo, porque lo que tiene ahí es una barbaridad. Nunca lo hicimos para lanzar la web, y de hecho su tráfico es natural y es una barbaridad. Pero claro, tampoco tiene una monetización directa. El tío es campeón de europa, muy prestigioso toda la vida, pero ahora va a los sitios y los jóvenes lo conocen por el blog, tiene un par de libros publicados… Ese es el éxito o rendimiento efectivo, nada más. Quizás una vez establecido deberíamos pensar así. Y ahora claro, me da miedo que con todo lo que tiene ahí pierda hasta eso angeljareno.es

Pues algo tendrá que hacer además del JS para evitar imprimir y el clic derecho. Por ejemplo, he comprobado que se puede incrustar el contenido en otros sitos mediante oEmbed, y que faltan protecciones de seguridad que ayudarían, como protección contra iframes y tampoco tiene cabeceras de seguridad, con lo que otros sitios pueden importar su contenido – entre otras cosas – de manera super sencilla, mediante feeds o simplemente haciendo scrapping.

Vamos, que algo más se puede hacer 🙂

jajajaj Gracias. Miro todas esas cosas. Muy interesante lo de la IA como nueva búsqueda, mata todo lo que sé o hemos estado trabajando en contenidos o no… great moment to be alive o no…

El momento es importante, pero de ahí a fantástico… no sé Rick, parece falso 😀

😀